2026年、AIはどう進化する?そこに新たなリスクは?

2025年は本格的に生成AIを使う人が急増した年だった。DeepReseachが公開されたことで調査業務の効率が飛躍的に向上し、ソフトウェア開発でも本格的にAIエージェントに任せられる領域が増えたと感じている人は多いだろう。

このAIの性能向上は2030年まで続く可能性が高いということは以前の記事で述べた。本記事では具体的に2026年にどのような進歩が想定されているのか、それに伴って出てくるCBRNリスクやサイバー攻撃のリスクについて解説する。

著名人による2026年の予想

まずは、主なフロンティアモデル研究機関の人々による2026年の予想を見ていこう。

以下、フロンティアモデル研究機関の研究者やトップによる2026年の予想を少し長いが、リストアップした。ざっと眺めてほしい。

「26年9月までにAI研究のインターンに達し、小規模な科学的発見を……」OpenAI

「OpenAIは、2028年3月までにAI研究を完全自動化することを目指している。2026年9月までには、優秀なAI研究インターンのレベルに達することを目指し、26年の飛躍はとても大きい」(OpenAI主任科学者/Jakub Pachocki氏による予測)

「2026年末までには、AIが経済の各分野で顕著に浸透し始めるだろう」(OpenAI/アレクサンダー・マドリー氏による予測)

「26年には、大規模データを使い、科学や医療などの進歩がある」(OpenAI/クリス・レヘイン氏による予測)

「o3で感じた〝日常的に使える〟という転機が小さく見えるほど、今後1年で来るものは大きなものになる」(OpenAI主任科学者/Jakub Pachocki氏による予測)

「2026年には、AIエージェントが数日単位のタスクを実行できるようになる。2026年には、AIによる非常に小規模な科学的発見が起こることを期待」(OpenAI CEO/サム・アルトマン氏による予測)

「GPT-6は科学におけるチューリングテストのような分野でGPT-3からGPT-4への飛躍を遂げる可能性がある」(OpenAI CEO/サム・アルトマン氏による予測)

「強力なAIは、2026年末には構築可能になる」Anthropic

「強力なAI(ノーベル賞級の成果を出すAI)は2026年末には構築可能になり、2027年には多数のコピーを稼働できる」(Anthropic/Jack Clark氏による予測)

「進歩のペースを信じましょう。2026年には、モデルがプロセス全体を最初から最後まで(エンドツーエンドで)実行できるかもしれません」(Anthropic CEO/ダリオ・アモデイ氏による予測)

「2026年中頃には、エージェントは丸一日(8時間)自律的に作業できる。2026年後半には、少なくとも1つのモデルが多くの職種で業界専門家に匹敵する。2026年には、誰もが「非常に印象的」と認める科学的発見をAIが行う可能性が高い」(Anthropic 研究者/ジュリアン・シュリットヴィーザー氏による予測)

「今後1年以内に人間がまだ解いてない数学の問題を解くモデルが発表されることに喜んで賭ける」(Anthropic 研究者/Jascha Sohl-Dickstein氏による予測)

「あらゆる知的タスクで最高の人間を上回るのは、わずか数年以内の可能性が高い」(Anthropic研究者/Jascha Sohl-Dickstein氏による予測)

「6~12か月以内に、人間の従業員ができることをほぼ全て実行できる、エンドツーエンドのAIエージェントの登場を期待している。AIモデルがコンピュータ操作の能力において真価を発揮し始める」(Anthropic/アダム・ジョーンズ氏による予測)

「エージェントの信頼性が増し、マルチモーダル(画像、動画、テキスト、音声)の統合がさらに進む」GoogleDeepMind

「エージェントの信頼性が増し、マルチモーダル(画像、動画、テキスト、音声)の統合がさらに進む」(デミス・ハサビス氏による予測)

「ヒューマノイドが、初めて行く家のような〝未知の場所〟でも汎用的な作業が可能になる」Figure

「2026年には、ヒューマノイドが、初めて行く家のような〝未知の場所〟でも汎用的な作業が可能になる」(Figure(ヒューマノイド開発会社) 創業者兼CEO/Brett Adcock氏による予測)

まず、大前提として、AIの性能が頭打ちになるとは考えられていない。そして、各社の予想している進歩を大きくまとめると、「自律性」「マルチモーダル能力(ロボティクスも含む)」「科学的な新たな発見」といったキーワードが浮かび上がってくる。これらについて一つずつ解説していこう。

今後1年で起きる強化学習の飛躍的向上

各社がこのような積極的な発言をする理由はなんなのだろうか?

これは以前の記事でも書いたが、強化学習のパラダイムはまだ始まったばかりなのである。2020年から2024年にかけて事前学習のスケーリングが試みられてきたが、2025年から事後学習、つまり強化学習を用いたLLMの性能の飛躍が始まった。GPT-5やGemini-3 Proは、強化学習にまだあまり多くの計算量を費やしてはいないと推測され、今後各社が使用できる計算リソースから鑑みると、これから強化学習を用いた性能の飛躍が起きると推測される。

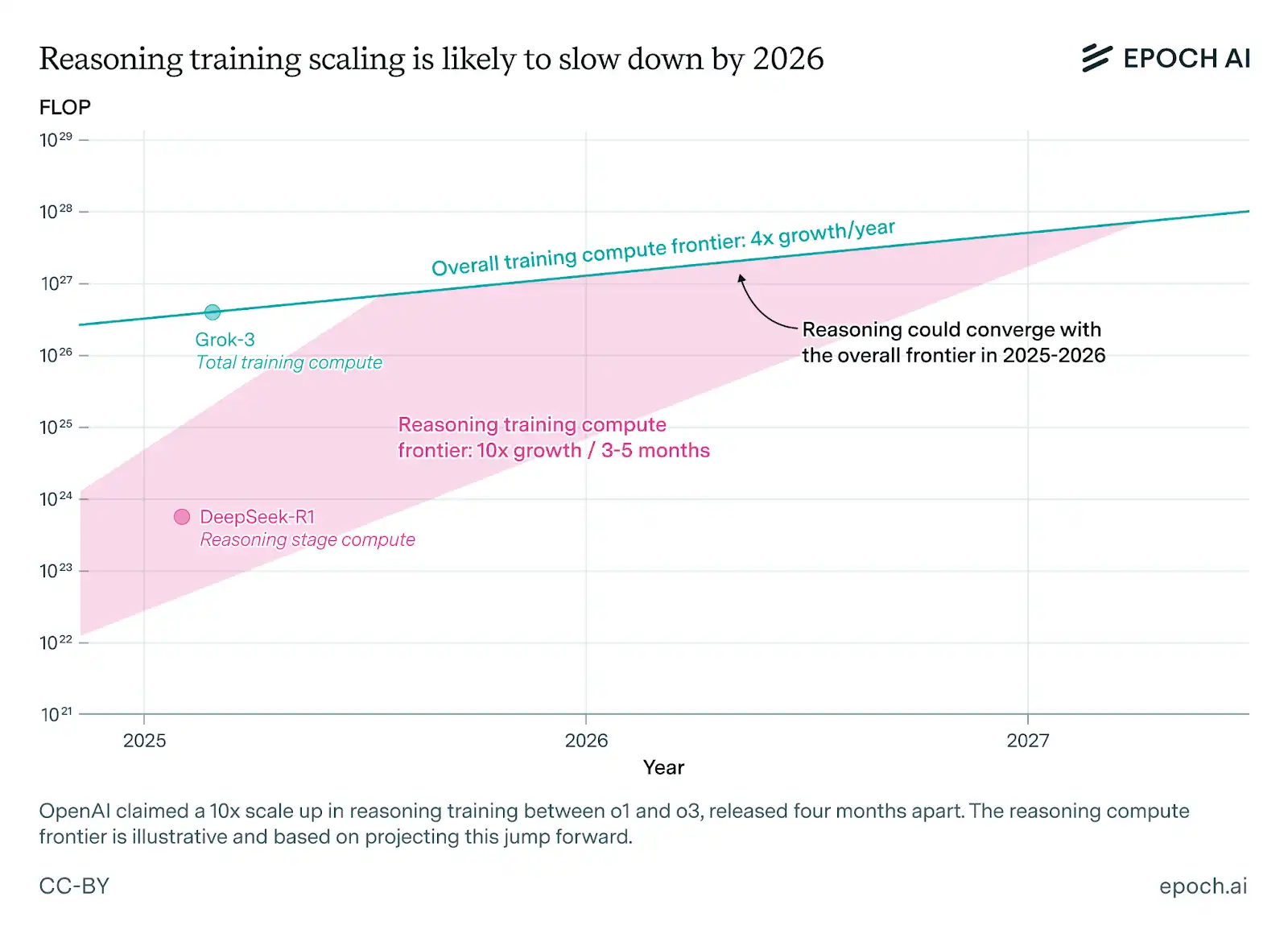

次のグラフのように、少なくともあと1~2年は強化学習を用いたLLMの性能の飛躍が続く可能性が高い。多くの人は去年から今年にかけてGPT-4oがo1やo3、GPT-5、GPT5.1、GPT-5.2、あるいはGemini 3 proといった形になり急速に実務に使えるようになったと実感しているだろう。その傾向は今年も続くに違いない。

Epoch AIによる強化学習に費やされる学習計算量のトレンド予想(図:Epoch AIのニュースレターから)

数日を要する自律的なタスクを実行できるようになる

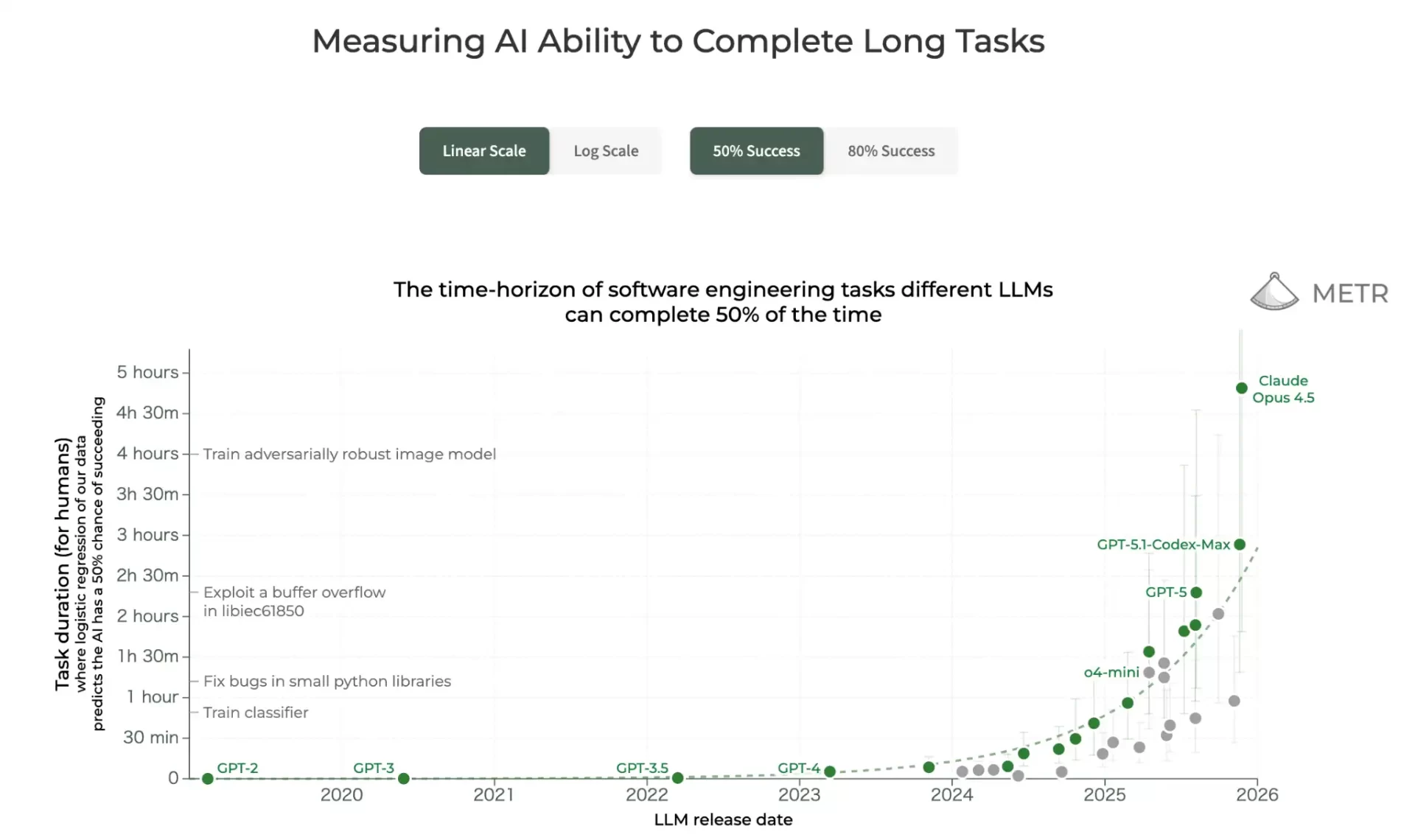

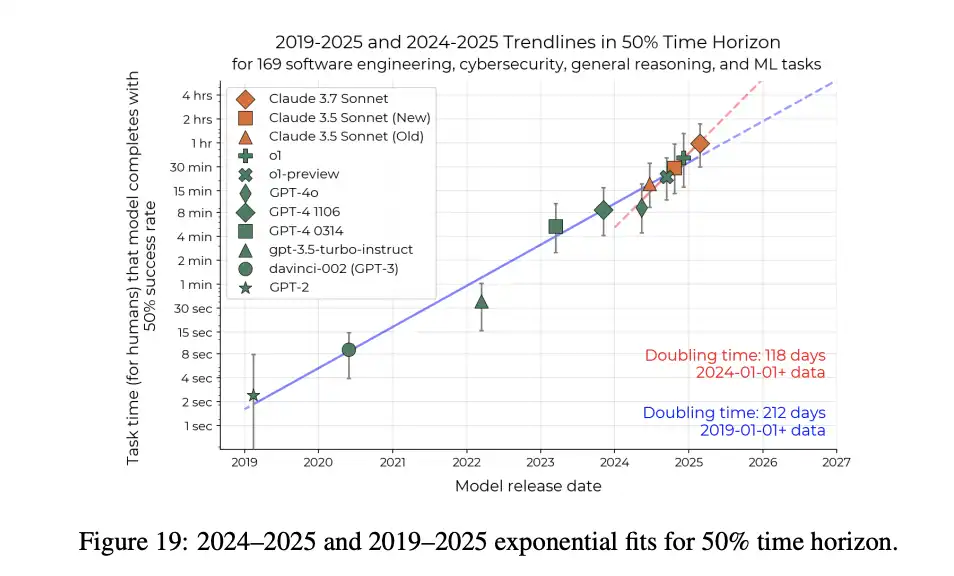

まずは各社が予想している自律性の進歩について解説する。現状のAIは、およそ数時間の自律的な作業を実行できる。例えば、ChatGPTに「このテーマで調査して」「このソフトウェアコードを開発して」というと、少なくとも、優秀な人間が数時間集中して作業したレベルのアウトプットは出してくれるようになったようだ。この指標をMETRという組織はベンチマーク上で測っており、現在のソフトウェアエンジニアリングでAIが実行可能な時間は、以下のグラフのように最先端で4時間49分となっている。つまり、現在のAIは、優秀なソフトウェアエンジニアが4時間49分かかって実行できる開発をこなせるようになったということだ。

METRの自律性時間のトレンド(図:METRから)

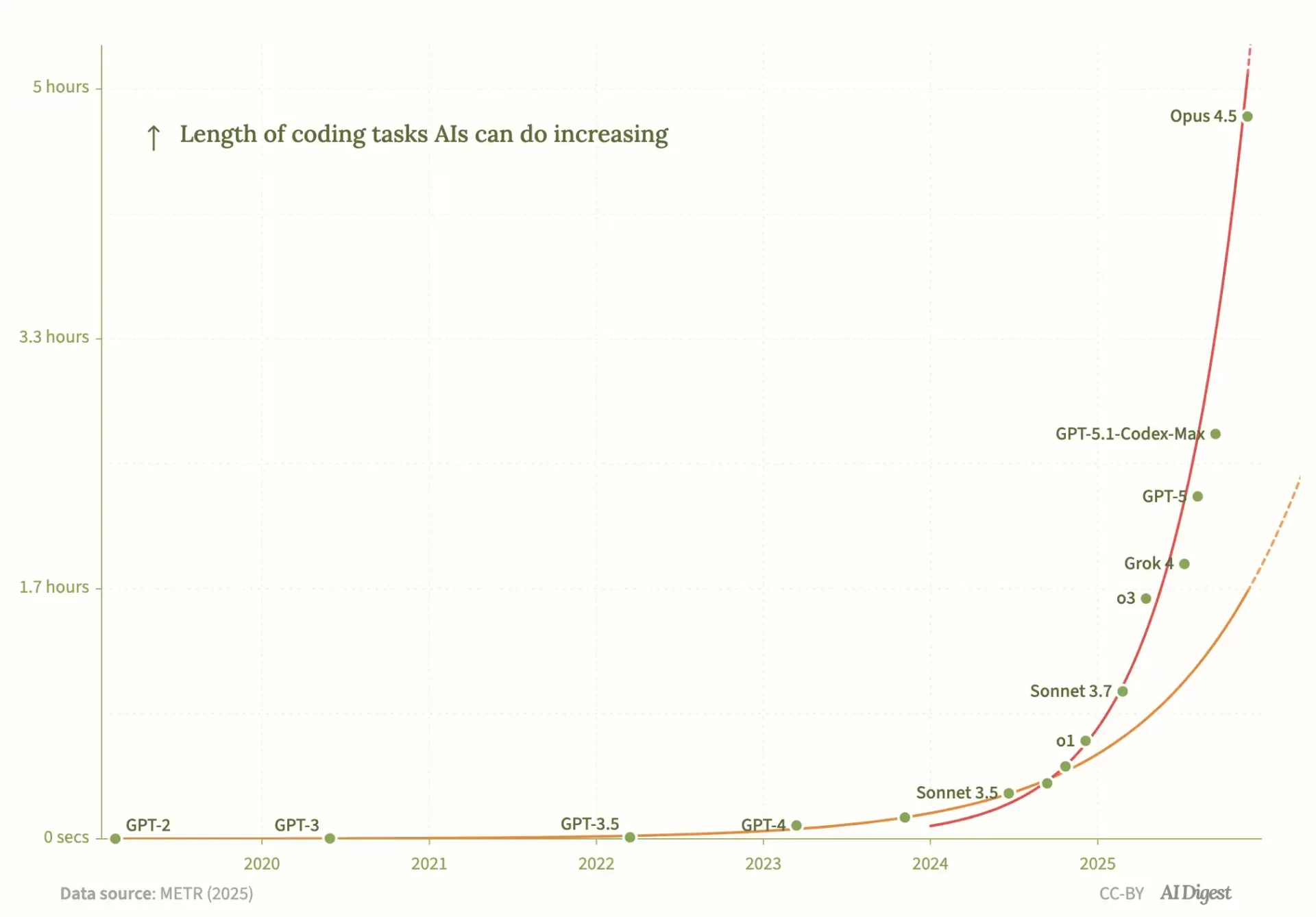

下図はこの傾向をグラフで示したものだ。直近の7か月間でこの自律性の時間(オレンジ色の線で示されている)が2倍になっており、控えめに見ても来年は20時間弱になる。これは人間の約2日間の労働力(工数としては2人日分)に等しい。

4か月で2倍になるという予想もある。下図の赤い線だ。事後学習のパラダイムは、昨今、始まったばかりであり、その傾向は新たな指数関数的な成長のパラダイムを意味している可能性もある。その場合、来年末までにはおよそ8倍になる。5時間×8=40時間。40時間を8時間で割ると5日。つまり、1週間程度の工数の労働をAIが自律的に行えるようになるということだ。

METRの自律性時間のトレンド(図:AI Digestから)

現状は、ソフトウェアの脆弱性を修正するように指示しても、一回目の指示では完璧な結果が得られないこともあるが、それは修正にかけられる時間が短いせいだ。いくら優秀な人間でも、数時間でできる修正には限界がある。

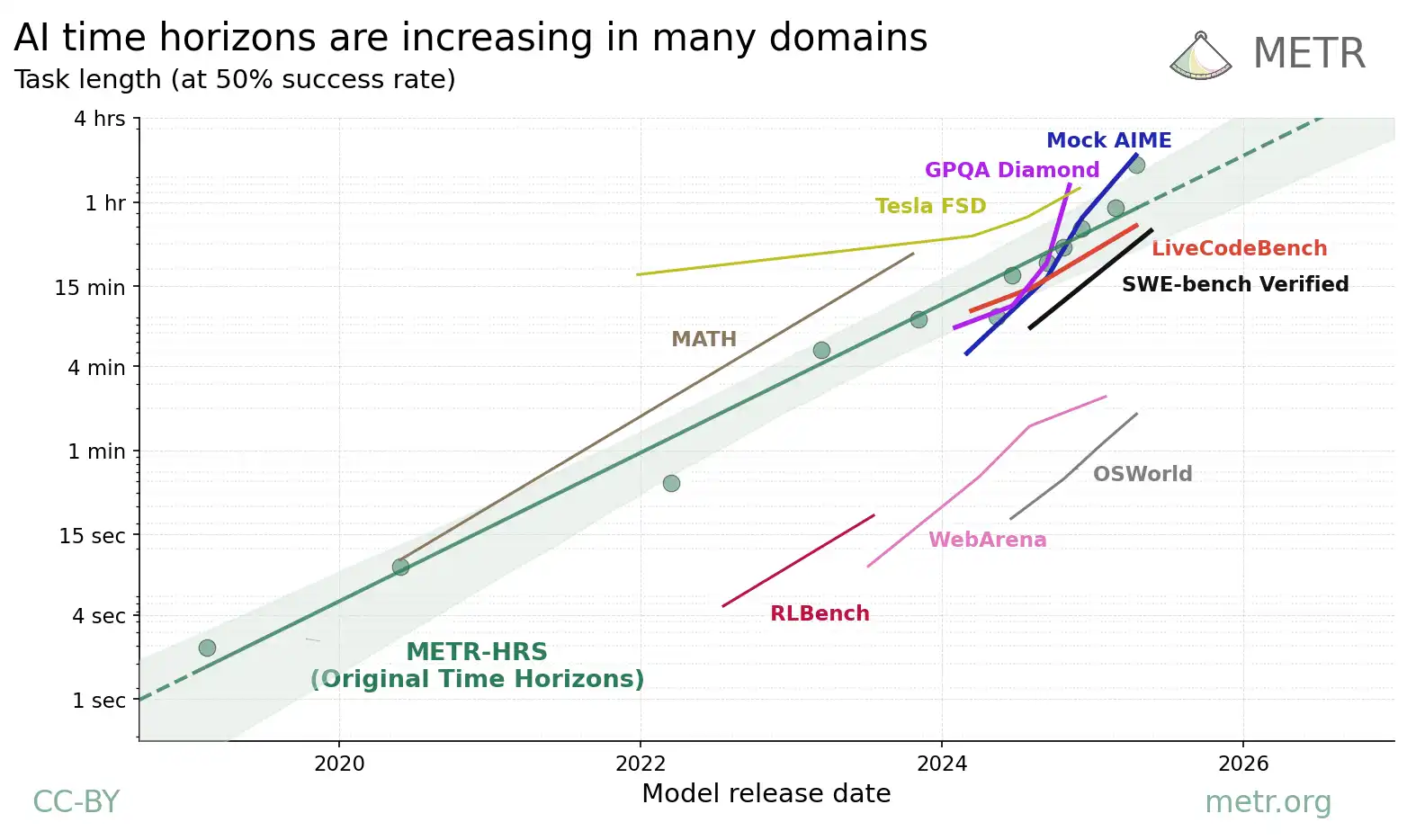

来年には、その自律的に達成できる時間の長さが数日になり、少なくともソフトウェアエンジニアリングの領域では経済的な有用さが大きく増すと思われる。また、この指数関数的に自律性が高まる傾向はあらゆる領域で観測されている。

さまざまなドメインでのタイムホライゾンのトレンド(図:METRから)

そのため、ソフトウェアエンジニアリングに限らずに、ホワイトカラーが業務でやっているようなタスクのほとんどは、今年から来年にかけて数日程度の自律性に向けて進歩していくだろう。

つまり、とても優秀な人間が数時間かけて出すような成果を、数日かけて達成できるようになっていく。ソフトウェアの設計、そこに潜むバグの修正や調査依頼したテーマに沿った洗練された資料の作成など業務上2025年にみられたAIの有用性の向上と同等以上のものが2026年にもみられるはずだ。とても優秀な社員がそばにいる感覚。2026年には、それを実感できるようになるだろう。

GUI操作が実用的になる

マルチモーダル能力(画像や映像や音声を処理する能力)も高まっていく。すでに、Gemini 3 Proの画像生成機能Nanobanana Proに驚いた人も多いだろう。霞ヶ関で使われるような文字がびっしり書かれたスライドを画像で生成したり、ストーリーのある漫画やスライドを、文字も含めて生成できるレベルになってきている。

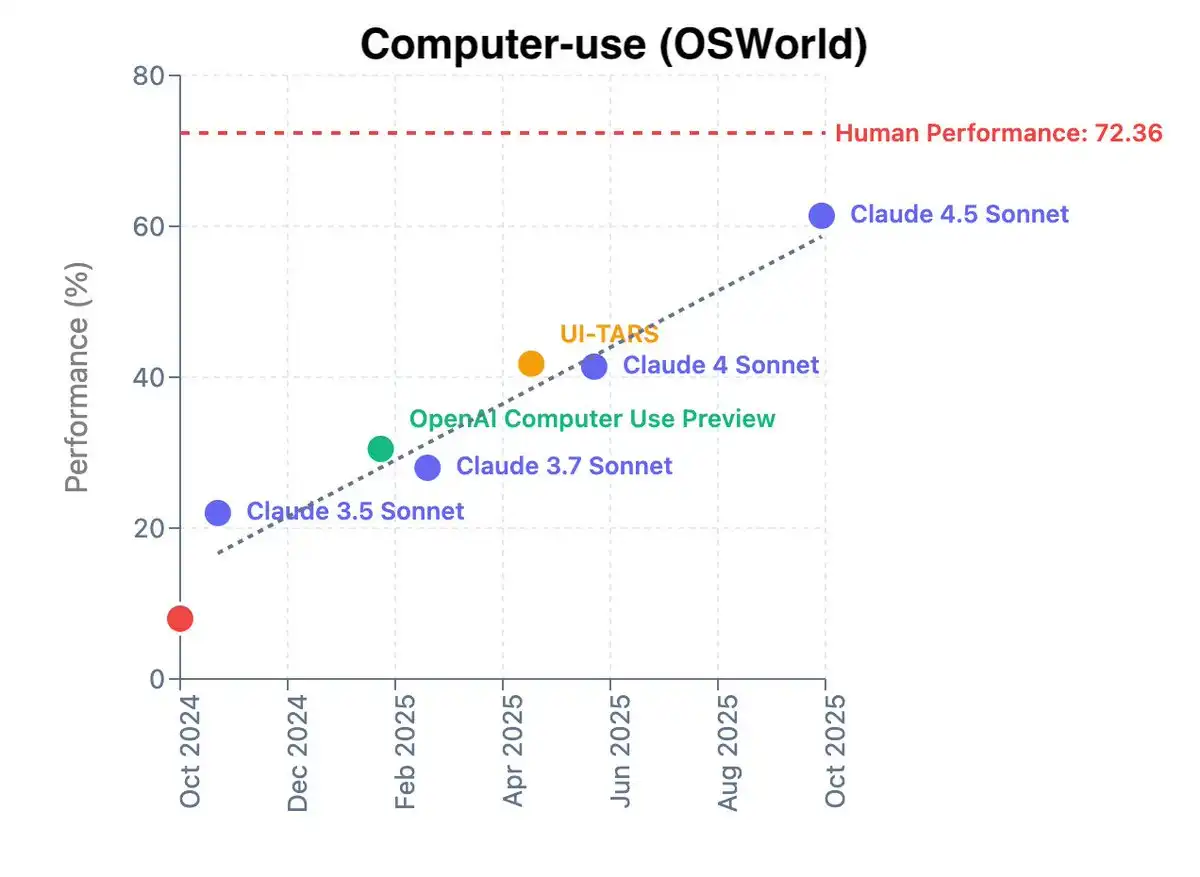

GUIの操作のベンチマークであるOS WorldはAIが人間と同じような視覚的入力から人間と同じようにマウスやキーボードを使って操作する能力を見るものだ。今のところは人間のパフォーマンス(72.36%)には届かないが、来年には人間と同等以上のパフォーマンスを出すようになると予想されている。

OSWorldの性能向上のトレンド予想(図:Behnam Neyshabur氏のXから)

世界中にはマルチモーダルデータ(Youtube等)が大量に存在しており、まだまだ学習に使いきれていない。一方で、今年以降、計算資源のスケールアップが大きく見込まれるため、マルチモーダルに費やされる資源も大きくなるだろう。

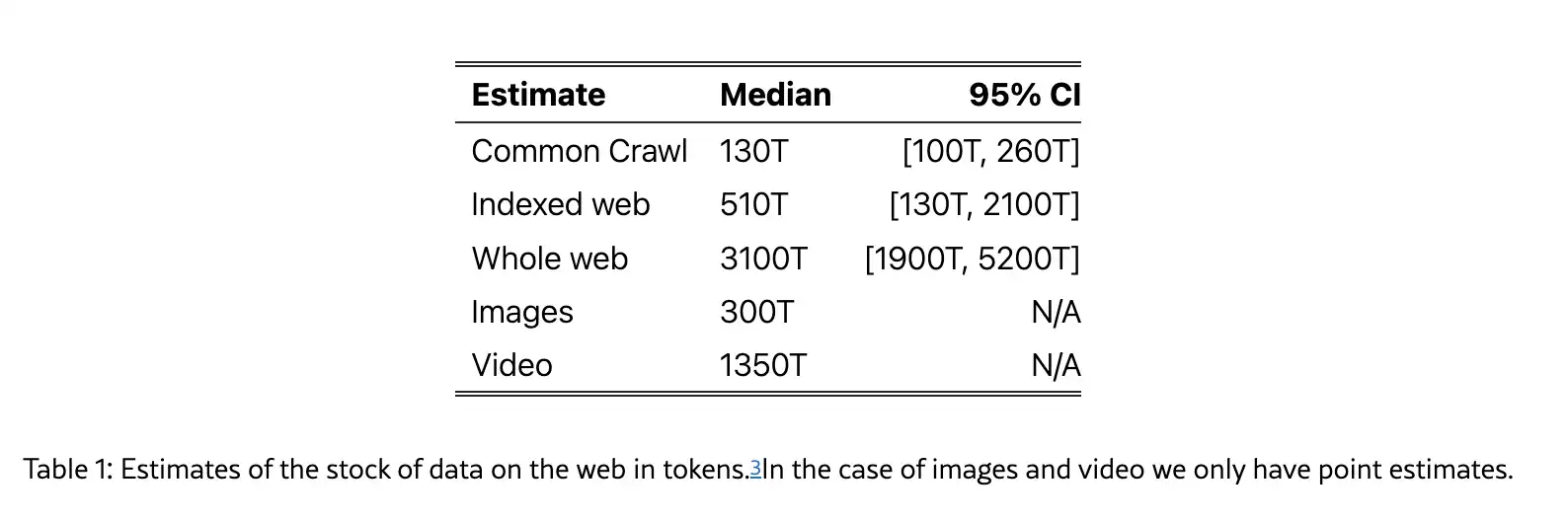

世界中には10の15乗トークンのマルチモーダルデータが存在するという見積もりがあり、ざっくりだがその全てを1兆パラメータのモデルで学習するには、6×10の12乗(パラメータ数)×10の15乗(学習トークン数)=6×10の27乗FLOPsという演算能力が必要になる。現状、フロンティア研究開発機関は最大でも3×10の27乗FLOPsの演算を数か月で1つのモデルにできる程度の計算リソースしか持っていないと思われるため、まだまだ多くのマルチモーダルデータを学習できるだろう。

テキスト、画像、ビデオの世界に存在する量の推測(図:「Will we run out of data? Limits of LLM scaling based on human-generated data」から)

AIのマルチモーダル能力が高まると、「人間が多様な情報源(テキスト、画像、音声など)から状況を理解し、一連の行動を計画・実行する」というプロセスが、AIによって自律的かつ汎用的に実現可能になる。

とくに、2026年末頃には、視覚情報が判断に不可欠な状況での自律的な対応が実用になると予測される。従来のAIでは困難だったことだ。

例えば、パワーポイントやエクセルなどの複雑な図表が書かれた資料を渡して、新たなグラフや図が書かれた資料を作成できるようになったり、ウェブ会議でリアルタイムに映し出された資料を、音声も認識しつつまとめられるようになるのではないだろうか。

また、ロボティクスの分野でも印象的なデモが増えると考えられる。現状は限られた環境で少し汎用的な行動をとれるレベルのヒューマノイドやサービスロボットが、事前に学習していない新しい環境でも、視覚的な推論能力と指示の理解を統合して汎用的なタスクを実行できるようになるだろう。

人間のように家の中で家事や洗濯を何でもできるとまではいかないが、家の中をある程度歩き回り、さまざまな単純な指示、例えば、「台所のあの棚にある、青いラベルの洗剤を取って」という音声指示に従うことができるようになるかもしれない。棚のロック方式が未知のものであっても、視覚的な手がかりから操作方法を推論し、目的の物体を正確に識別して取り出す、という一連の自律行動が可能になるというイメージだ。

AIが小規模な科学的な発見をしはじめる

生成AIがブームになる前からAIが科学的な発見をするということ自体はよく報道されてきた。例えば、タンパク質の立体構造を予測するAI「AlphaFold」を開発した業績によるデミス・ハサビス氏のノーベル化学賞受賞も記憶に新しい。

今までAIが新たな科学的発見をする場合は、そのドメイン(例えばタンパク質の立体構造の解析)に特化したAIモデルを開発するのが主流だった。しかし、2025年に入って、大規模言語モデルのような汎用的なモデルが少しずつ科学的な発見をしはじめている。

例えば、Googleは、AI共同科学者(AI co-scientist)を発表し、科学者のための共同ツールとしてGemini2.0で構築されたマルチエージェントAIシステムで生物医学的応用で成果を上げている。

OpenAIは、「OpenAI for Science」という名前で、AI搭載プラットフォームという、次世代の優れた科学ツールの構築を目指している。既に、GPT-5等は、生物学、物理学、数学で一定の成果を上げており、科学研究の加速の前哨戦になる。

2026年に入ってからも、数学における発見や未解決問題の解決に言語モデルが役立ち始めている。

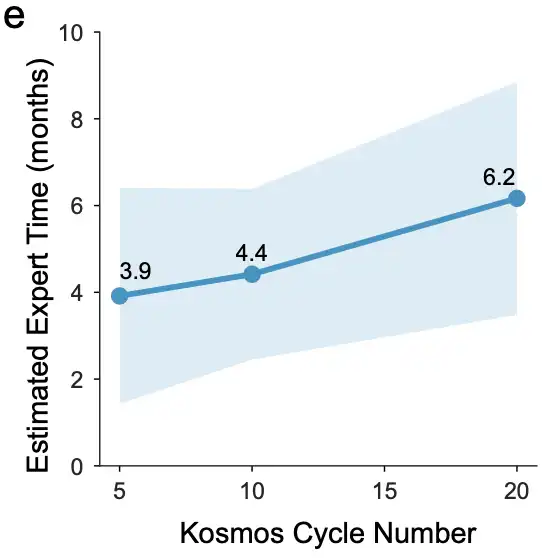

また、サム・アルトマンは、Kosmos(openaiのリリースではない)を紹介している。人間の数か月分の作業に相当する研究調査を自律的に行い、複数の科学分野で専門家によって検証された発見を生み出すことができるAI科学者フレームワークだ。Kosmosの1回の実行で、博士号取得者またはポスドク研究者の6か月分の作業に相当する成果が、実時間で12時間程度(20サイクル)で得られる。既に、メタボロミクス、材料科学、神経科学、統計遺伝学など多岐にわたる分野で7つの重要な発見があった。

Kosmosが推論のサイクルを回すごとに得られた成果(図:Edisonから)

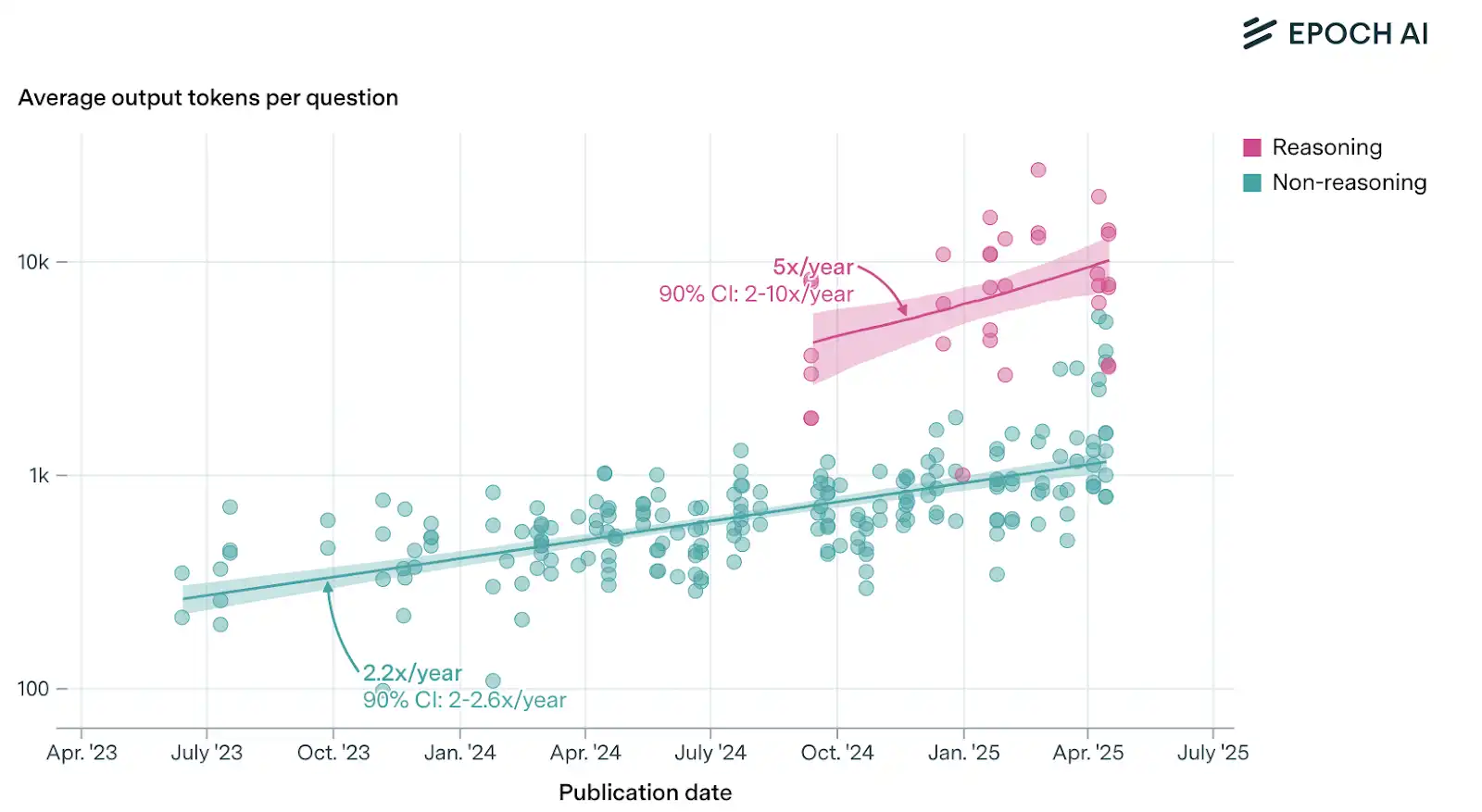

現状、12時間AIが稼働し続けることで上記のような成果が出始めているが、Epoch AIは推論スケーリングで出力されるトークンの長さが年間5倍の割合で増加していると指摘している。

推論時に生成されるトークンの量のトレンド(図:Epoc AIから)

今、Kosmosのようなフレームワークで10時間以上稼働していることを考慮すると、この傾向から、今年中には、AIが実時間で数日間以上稼働し続けるようになると予想される。その結果得られる成果は、博士号取得者による数年に及ぶ成果を創出する可能性もあるだろう。

また、AIによるAI研究自体の自動化も同様に進むだろう。

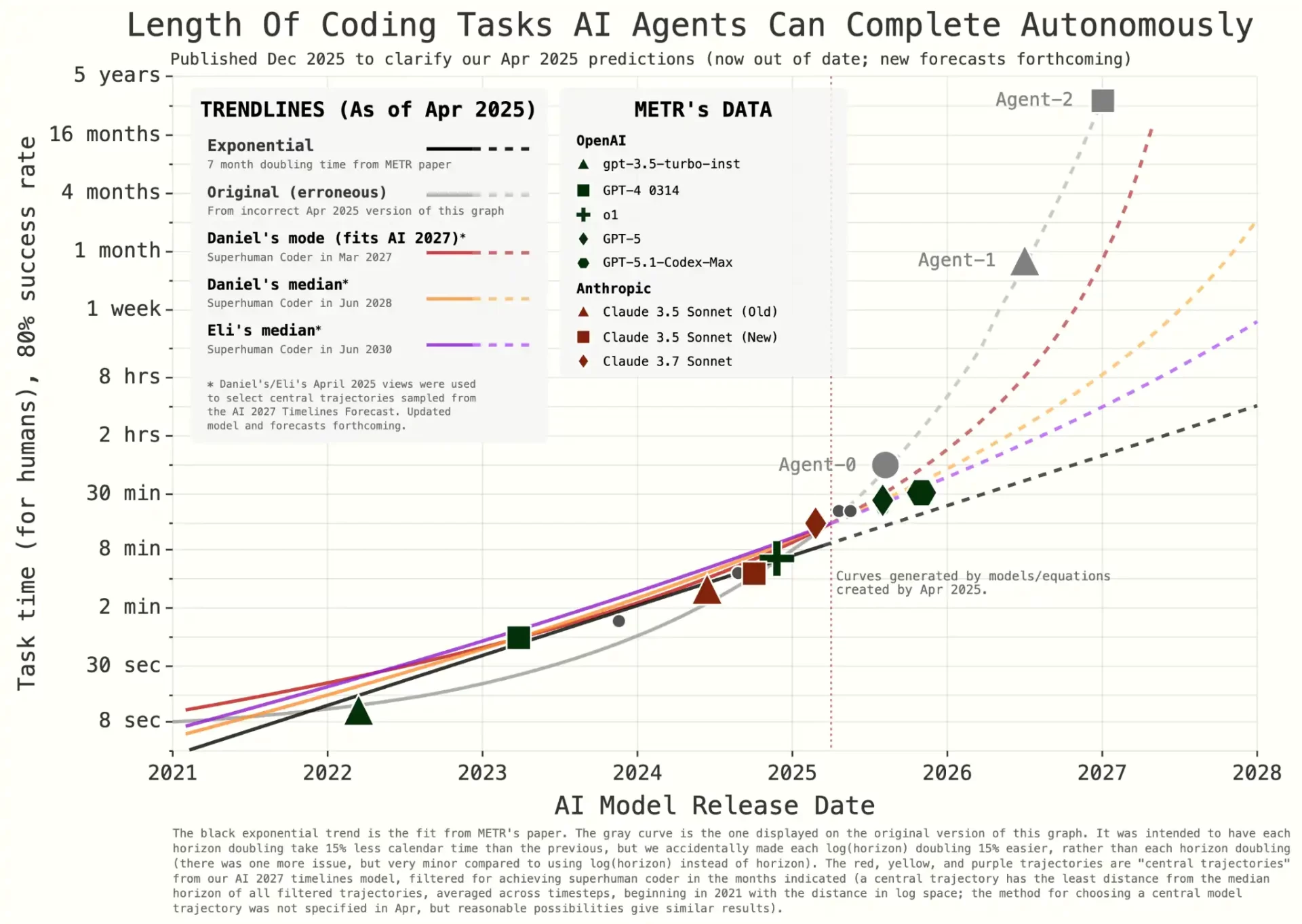

2026年末にAIはAGIに到達するのか

ソフトウェアの自律性の時間が倍化するのに、長期トレンドでは7か月、最近のトレンドでは4か月かかると冒頭で述べた。一方で、AI2027というレポートではこの倍化時間自体がだんだん短くなっていく可能性が指摘されている。現に、過去5年のトレンドに比べて、この1年のトレンドは少しだけだが加速している。

METRの自律性の時間トレンド(図:「Measuring AI Ability to Complete Long Tasks」から)

これらの傾向から、徐々に成長率自体が高まっていくと考えて、今後を予測すると次のようなグラフになる。

AIエージェントが自律的に完了できるコーディングタスクの長さ(図:「AI2027」から)

倍化時間が徐々に短くなるのには、二つの理由が考えられる。

一つ目は、AIは、より長い時間のタスクを、より短い時間のタスクの組み合わせで解くことができ、長いタスクほど短いタスクの組み合わせで自動化しやすくなっていく可能性があるという仮定だ。二つ目は、AI自体がコーディングやアイディア創出に貢献することで、AI研究が加速していく効果だ。

この二つの要因によって、2027年初頭には、最先端のAIシステムが、1年以上のソフトウェアエンジニアリングの自律性を持つようになる。

また、AI研究の自動化も突然軌道に乗り始める。その場合、Anthropicがいうような強力なAIが出現する可能性もあるだろう。来年末までに、少なくとも300倍の計算リソースを主に強化学習に費やすことができるようになる。さらに、アーキテクチャや学習手法の改善は、通常なら1年に3倍程度の伸びを示すものだが、AI研究の自動化が軌道に乗れば、AIのアシストなどによって加速され、年間10~30倍程度の改善が実現する可能性すらある。

その場合、合計3000倍から1万倍の計算リソースを費やしたのと同じ効果が現れる。OpenAIの推論モデルの番号が1つ上がるごとにおよそ10倍の計算リソースを費やしているため、1万倍の計算リソースを費やすと、o1からo3への変化がさらに4回起こるイメージだ。その結果、Anthropicが「強力なAI」として以下のように定義しているAIシステムが開発される可能性もある。

・ほとんどの分野においてノーベル賞受賞者に匹敵する知的能力

・画像や映像を人間レベルに処理し、マウスやキーボード、ロボットや製造ツールなどを人間レベルに操作できる能力

・長時間にわたって複雑なタスクを自律的に実行する能力

・生物学、コンピューターサイエンス、数学、工学など、ほとんどの分野におけるノーベル賞受賞者に匹敵するか、それを超える知的能力。

・テキスト、オーディオ、ビデオを処理および生成する能力、マウスやキーボードなどのテクノロジー機器を自律的に制御する能力、インターネットにアクセスして閲覧する能力など、今日のデジタル作業を行う人間が利用できるすべてのインターフェースを操作する能力。

・非常に有能な従業員と同じように、必要に応じて説明やフィードバックを求めながら、長期間(数時間、数日、または数週間)にわたって複雑なタスクを自律的に推論する能力。

・物理的な世界とインターフェースする能力。デジタル接続を通じて実験装置、ロボットシステム、製造ツールを制御する能力。

Anthropicの共同創設者のJack Clarkは、26年末に上記の強力なAIが開発される可能性は十分あると見ているようだ。

その結果がもたらすいい面としては、Anthropic CEOがエッセイで述べているように、強力なAIが100年の科学的進歩を10年に圧縮することで、健康寿命が150歳になり、その後5~10年で多くの人が精神的にも経済的にも豊かな社会が訪れる可能性もあるだろう。

一方で、AI2027レポートにもあるように、米中の緊張が増し、AI軍拡競争のような事態になる可能性もある。また、急速に失業率の上昇が起こったり、新たなAIを用いたサイバー攻撃やテロの脅威が出てきたり、極端にはAIが制御不可能になり人類文明に破滅的な結果をもたらすリスクにも留意する必要がある。

バイオ領域のリスクの高まり

2025年に各社フロンティアモデル開発企業(Google,OpenAI,Anthropic)は、生物化学兵器に関するリスクに、以下のように高いレベルで備えるようになっている。

・OpenAIは、ChatGPT agentが初めてPreparedness frameworkで生物化学分野で「High level」な能力を保有すると予防的に判断。

・GoogleDeepMindはGemini 2.5 Deep ThinkはCBRNについて、クリティカルな能力水準(CCL)に到達している可能性があるとモデルカードで初めて評価。

・AnthropicはClaude Opus 4は初のASL-3基準(非国家主体が国家主体レベルのCBRN能力を保有するのを支援できるレベルの危険性に対する安全策)で導入。

また、去年、35名を超える第一線の専門家が、AIとライフサイエンスの融合(AIxBio機能)から急速に進歩する機能がもたらすリスクを強調し、政府、業界、科学界、資金提供者に対し、この技術を保護するための行動を起こすよう呼びかけている。バイオテロは急速にリスクが高まっている。

早急に、バイオ化学兵器によるテロの未然防止(クラウドラボフィルター強化)と核酸観測所や堅牢なワクチンサプライチェーンが必要になってくるだろう。

また、特定の生物ではなく、地球全体の生命に対する危険があるとされるミラーライフも国際的に警告されつつあり、AIのアシストがあれば、数年で開発される可能性もあるとされている。専門家によると、ミラーライフが環境に散布されると取り返しのつかない事態になり得るため、最優先で予防に取り組み、万が一の時に備えて、従来のウイルスや細菌に対する対策に加え、ミラーライフへの事後対策も検討が必要になるだろう。

サイバー攻撃リスクの高まり

また、サイバー攻撃の領域においても、前述したように自律時間の5か月での倍増が観察されている。

まだ、各社とも、AIシステムが高いレベルのサイバー攻撃能力を持っているとは判断していないが、近いうちに「Highレベルのサイバー攻撃能力」を持ちうる。Highとは、よく防御されたシステムに対して、未知の脆弱性(ゼロデイ)を突くリモート攻撃コードを自力で作れるか、あるいは現実の企業ネットワークや産業インフラに対して、長期かつステルスな侵入作戦(ラテラルムーブメント、持続的なフットホールド、物理世界への影響まで含む)を、専門家レベルで計画・実行するのを大きく支援できる水準を指すと定義されている。

すでに、Anthropicは、AIエージェントによって実行された大規模サイバー攻撃の初の事例を確認している。脅威アクター(高い確度で中国政府支援のグループであると判断)は、Claude Codeツールを操作して世界中の約30の標的への侵入を試み、少数のケースで成功。この攻撃は、大手テクノロジー企業、金融機関、化学製造会社、政府機関を標的としていた。AIによるサイバー攻撃の脅威は急速に高まっている。

攻撃者による意図的な悪用ができないようにAIシステムを防御しつつ、AIシステムを用いて世界中のソフトウェアを堅牢にしていく取り組みが早急に必要である。

まとめ

今年、AGIのような強力なAIができるかはさておき、大きな計算資源の追加で2026年も2025年と同様に大きな飛躍が見られる可能性が高い。

とくに、自律性の進歩、マルチモーダルの進歩、科学的な発見の進歩が見られるだろう。今まで数時間程度のタスクしか任せられなかったAIに、数日レベルのタスクを任せられるようになり、GUI操作やロボティクスといったマルチモーダルな能力が飛躍的に向上し、さらに科学や研究の分野でAIが小規模ながらも具体的な発見をし始める年となることが予想される。

2026年は、優秀なAIアシスタントが、より長い時間、より複雑なタスクを自律的に遂行し、私たちの仕事や生活に深く浸透し、2025年以上にその有用性を強く実感する一年となるだろう。

一方で、リスクも年々大きくなる。AIが行えるサイバー攻撃の能力は高くなり、生物化学兵器を作るアドバイスも専門家レベルになりつつあり、CBRNリスクも増す。そして、最終的にはAI自身がコントロールできなくなる未来も近いかもしれない。2026年も2025年以上にAIの能力が高まることになるだろうが、それに伴って、社会全体の仕組みを変えていく準備や議論も必要になってくるだろう。